上回说到既然不能用直线,那何不尝试一下用其他的线来拟合数据?

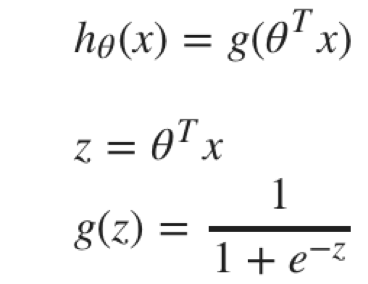

假设表示

sigmoid函数引入

其中0表示负向类,1表示正向类,则输出为0≤hθ(x)≤1

hθ(x)≥0.5,则预测y=1,既y属于正例

hθ(x)<0.5,则预测y=0,既y属于负例

这是线性回归无法做到的,由此引入Sigmoid Function

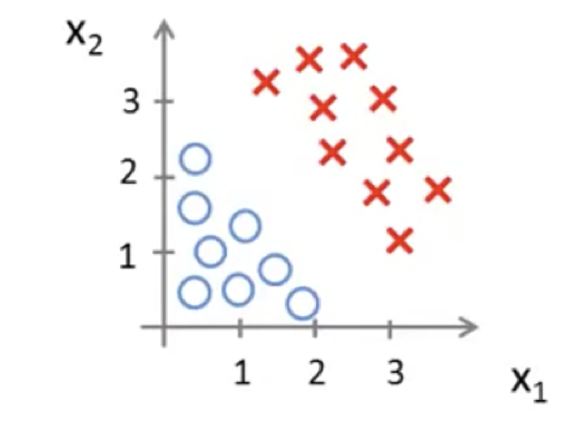

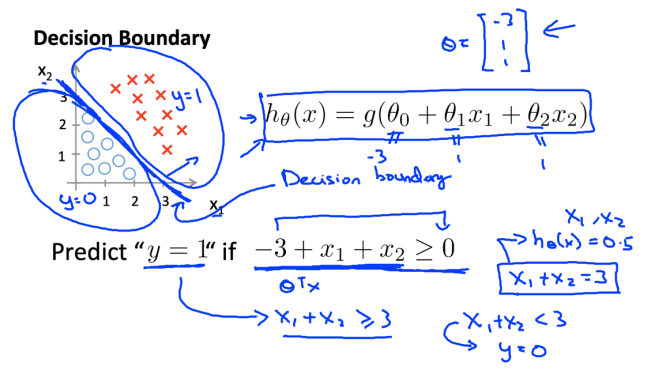

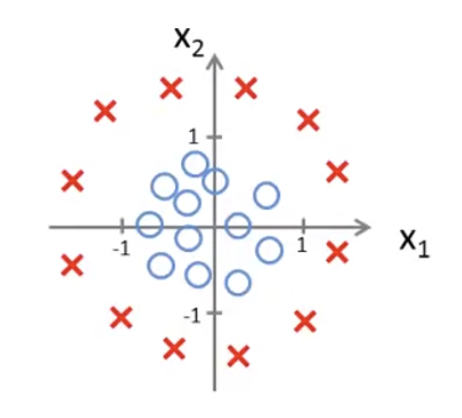

决策边界

假设函数为线性

设参数θ是向量[-3 1 1], 将具体数据带入下方公式计算

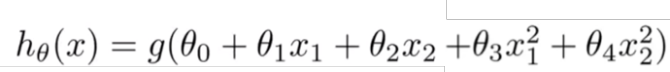

假设函数为非线性

小小补充

下次将会介绍逻辑回归的代价函数,逻辑回归的代价函数将不同于线性回归,但是目的都是让损失最小化,回归本元其实思路是一样的。其实线性回归和逻辑回归的梯度下降数学推导并没有很复杂,动动手推一遍将会加深不少理解。从数学角度去理解这个过程其实是一个相当明智的。